セミナーレポート

誕生間近の自ら学習し,人のために働くロボット東京工業大学 長谷川 修

本記事は、画像センシング展2012にて開催された特別招待講演を記事化したものになります。

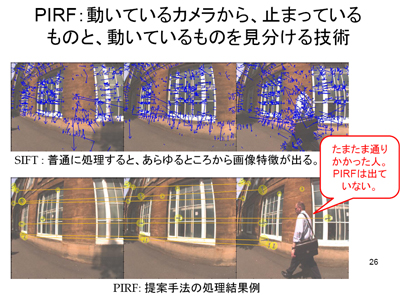

動いているカメラで,止まっているものだけを認識

このようなロボットは止まっているだけではなく,人間と同じように動くことで初めて,いろいろな役割を果たすことができます。そのために,私たちは,PIRF(Position Invariant Robust Feature)という,動いているカメラの映像の中から,止まっているものだけを取り出す技術を開発しました(図2)。

図2 PIRFの処理結果例

PIRFはものを見分けるのではなく,安定しているものだけを残します。それを工夫して使うことで,例えば,休日で車が停まっていない駐車場と平日で車がたくさん停まっている駐車場の画像を同じ場所だと認識することができます。PIRFでさまざまな実験をしていますが,大学キャンパスの周りを2回回り,車や人が動いている中で,2回目で1回目に通ったところかどうかを答えさせました。オックスフォード大学が開発したFAB-MAPというやり方では認識率は43.32%でしたが,PIRFは80.04%と倍近い性能を出すことができました。加えて,FAB-MAPはバッチ処理が必要ですが,PIRFは完全オンラインで可能です。また,東京渋谷の地下街に109ビルのところから入り,田園都市線の改札まで2回歩き,2回目で1回目のどこかを答えさせる実験もしましたが,かなり高い率で認識させることができました。

今,PIRFの応用として,考えているのは介護施設で車イスに付けて,自動運転できるようにすることです。車イスは介護士1人で1台しか押せないため,大勢いると大変な負担になり,車イスの高齢者も自分の番を待っていなければなりません。そこで,PIRFを付けた車イスを施設の中で動かして,「ここは受付。ここは食堂」などと見せていき,人が普通に歩いている中で,認知地図を作ります。そうすると,「あそこは受付。あそこは食堂といっていたな」と自動運転ができるようになります。こうしたことを重ねていく中で,人の生活環境の中で,自分でネットから情報を得て学習し,感覚情報などはロボット間で共有する,人の役に立つ知的システムができると考えています。

東京工業大学 長谷川 修

1993年,東京大学大学院 電子工学専攻 博士課程修了,博士(工学)。同年,通商産業省(現経済産業省) 工業技術院 電子技術総合研究所 研究員。1999年,米国カーネギーメロン大学 ロボティクス研究所 客員研究員。2002年,東京工業大学 大学院理工学研究科付属 像情報工学研究施設 助教授。2010年,東京工業大学 像情報工学研究所 准教授。 長谷川研究室 http://haselab.info/