セミナーレポート

ロボットに使える最新画像処理技術 ~物体認識のための画像局所特微量~中部大学 藤吉 弘亘

本記事は、画像センシング展2010にて開催された特別招待講演を記事化したものになります。

人と車両の画像で実際に評価

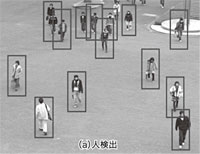

図9 ラスタスキャンを使ったJoint HOGによる検出例

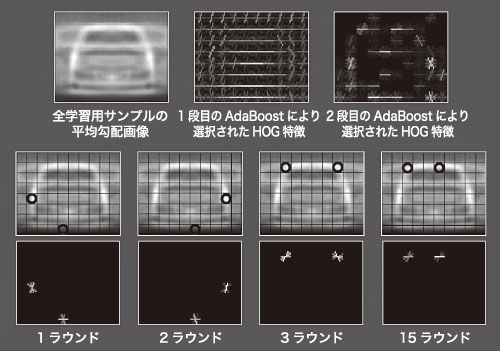

Joint HOGでは特に車両の場合,通常のHOGに比べて高精度に認識できることが分かります。実際の画像(図9,Webに動画像あり)では,従来の背景差分等では多くの人を分離して検出することは非常に難しかったのですが,Joint HOGを使うことによって精度よく検出できるようになりました。また,車両もほとんど失敗することなく検出できています。

図9 ラスタスキャンを使ったJoint HOGによる検出例

図10 自動生成されたJoint HOG特徴(車両検出)

<次ページへ続く>

中部大学 藤吉 弘亘

1997年,中部大学 大学院博士後期課程修了。1997年~2000年,米カーネギーメロン大学ロボット工学研究所Postdoctoral Fellow。

2000年より中部大学講師。

2004年,同大准教授。2006年,米カーネギーメロン大学ロボット工学研究所客員研究員。